Currículum

- 1 sección

- 7 lecciones

- 6 horas

Del Ábaco a la Computadora Moderna

El Origen de los Dispositivos de Cálculo

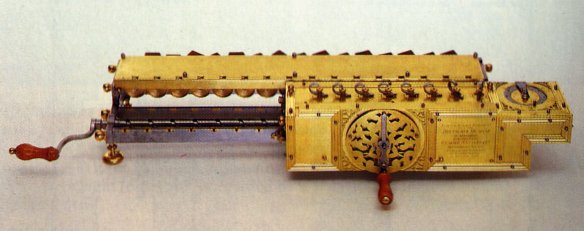

Los primeros dispositivos de cálculo se remontan al ábaco, un antiguo instrumento que permitió a las civilizaciones realizar cálculos simples. Este rudimentario sistema de cuentas inspiró a inventores como Wilhelm Schickard y Blaise Pascal, quienes crearon máquinas más complejas, como la Pascalina, capaces de realizar operaciones aritméticas básicas. Estos inventos pusieron los cimientos de lo que hoy conocemos como computadoras.

⚙️ Dato Curioso:

La Pascalina de Blaise Pascal fue una de las primeras calculadoras mecánicas comerciales, utilizada en el siglo XVII para ayudar a los recaudadores de impuestos a sumar grandes cantidades de dinero.

Leibniz y el Sistema Binario

Gottfried Wilhelm Leibniz mejoró estas calculadoras al inventar la famosa «rueda de Leibniz», que facilitaba la multiplicación y división. Su mayor contribución, sin embargo, fue el desarrollo del sistema binario. Este sistema numérico basado en 0s y 1s se convirtió en el lenguaje base de las computadoras modernas, permitiendo la representación de datos y comandos de una forma simplificada.

⚙️ Dato Curioso:

No me puedo resistir a publicar este vídeo donde se documenta la disputa por la invención del cálculo infinitesimal de una manera muy graciosa, aunque no tenga que ver con el tema a tratar.

El sistema binario es un sistema numérico en base 2, donde todo se representa utilizando solo dos guarismos: el 1 y el 0. Este sistema es fundamental para el funcionamiento de los computadores, ya que, mediante la electrónica, es muy sencillo representar dos estados.

Como ya señaló Leibniz, el sistema binario ofrece ciertas ventajas al realizar cálculos, debido a su simplicidad a nivel electrónico y computacional. Sin embargo, también tiene una desventaja notable: los números grandes en binario ocupan más espacio que en el sistema decimal.

⚙️ Dato Curioso:

El sistema binario es la base de toda la informática moderna, pero ¿sabías que sus orígenes datan del siglo XVII? Fue el matemático alemán Gottfried Wilhelm Leibniz quien, en 1703, documentó por primera vez cómo representar números utilizando solo los dígitos 0 y 1. Publicó su descubrimiento en el artículo“Explication de l’Arithmétique Binaire”, aunque en ese momento no tenía una aplicación práctica. Sin embargo, casi 300 años después, con la llegada de los primeros ordenadores, el sistema binario de Leibniz se convirtió en la base fundamental de la programación informática.

Otro gran pionero que aportó al desarrollo del sistema binario fue el matemático británico George Boole.En 1854, Boole publicó un artículo que detallaba un sistema de lógica, conocido como Álgebra de Boole, basado en la teoría del sistema binario. Esta fue clave para el desarrollo de los circuitos electrónicos modernos.

Nota Pedagógica: El sistema binario es fundamental para entender cómo las computadoras procesan la información hoy en día. Enseñar su aplicación es clave en el aprendizaje de programación y algoritmos.

Tabla de la Verdad: Operaciones Booleanas Básicas

| A | B | NOT A | A AND B | A OR B | A XOR B |

|---|---|---|---|---|---|

| 0 | 0 | 1 | 0 | 0 | 0 |

| 0 | 1 | 1 | 0 | 1 | 1 |

| 1 | 0 | 0 | 0 | 1 | 1 |

| 1 | 1 | 0 | 1 | 1 | 0 |

Descripción de los Operadores Booleanos

- NOT A: Invierte el valor de A. Si A es 1, el resultado es 0; si A es 0, el resultado es 1.

- A AND B: El resultado es 1 solo si tanto A como B son 1. De lo contrario, el resultado es 0.

- A OR B: El resultado es 1 si A o B (o ambos) son 1.

- A XOR B: El resultado es 1 si solo uno de los valores (A o B) es 1, pero no ambos.

Ejemplo Práctico: Sistema de Alarma de Seguridad

Imagina que tienes un sistema de alarma que se activa bajo ciertas condiciones. Los sensores detectan dos situaciones:

- A: La puerta está abierta (1) o cerrada (0).

- B: La ventana está abierta (1) o cerrada (0).

El sistema debe activar la alarma solo si una de las dos entradas está abierta, pero no ambas. Aquí es donde usamos el operador XOR.

Regla de Activación de la Alarma:

La alarma se activará cuando A XOR B = 1, es decir, cuando solo uno de los dos (puerta o ventana) esté abierto.

| Puerta (A) | Ventana (B) | Alarma (A XOR B) |

|---|---|---|

| 0 | 0 | 0 |

| 0 | 1 | 1 |

| 1 | 0 | 1 |

| 1 | 1 | 0 |

Ejemplo de Uso:

Si la puerta está abierta (A = 1) y la ventana cerrada (B = 0), la alarma se activará (1).

Si tanto la puerta como la ventana están abiertas (A = 1 y B = 1), la alarma no se activará (0).

Conclusión

Este ejemplo demuestra cómo las operaciones booleanas se pueden aplicar a un caso práctico, como un sistema de seguridad. Las tablas de verdad son esenciales para entender el comportamiento de variables en distintas condiciones, algo crucial en la programación y en el diseño de sistemas digitales.

A continuación, te mostramos cómo funciona el sistema binario. Dado que solo se pueden usar dos guarismos, el 1 y el 0, en cuanto necesitamos representar más de 2 unidades, tenemos que empezar a usar más de una cifra. Observa cómo se desarrolla en la siguiente tabla:

Sistema Binario: Conversión y Suma

| Decimal | Binario | Suma Binaria |

|---|---|---|

| 0 | 0 | = 0 |

| 1 | 1 | = 1 |

| 2 | 10 | = 1 + 1 |

| 3 | 11 | = 10 + 01 |

| 4 | 100 | = 10 + 10 |

| 5 | 101 | = 100 + 001 |

| 6 | 110 | = 100 + 010 |

| 7 | 111 | = 110 + 001 |

| 8 | 1000 | = 100 + 100 |

| 9 | 1001 | = 1000 + 001 |

| 10 | 1010 | = 1000 + 010 |

| 11 | 1011 | = 1010 + 001 |

| 12 | 1100 | = 1000 + 100 |

| 13 | 1101 | = 1100 + 001 |

| 14 | 1110 | = 1100 + 010 |

| 15 | 1111 | = 1110 + 001 |

Charles Babbage y Ada Lovelace: Los Visionarios de la Computación

A mediados del siglo XIX, Charles Babbage diseñó la primera máquina que se puede considerar como un prototipo de la computadora moderna: la máquina analítica. Aunque nunca se construyó por completo, este dispositivo podía realizar cálculos complejos y procesar datos de manera automática.

Ada Lovelace, considerada la primera programadora, escribió el primer algoritmo destinado a ser procesado por esta máquina. Su visión de que las computadoras podrían ir más allá de los cálculos numéricos y generar música o gráficos prefiguró las capacidades modernas de la tecnología.

Ada Lovelace elaboró una serie de estudios y llegó a diseñar un plan, que consistía en hacer que la máquina ideada por Charles Babbage pudiese ser reconfigurada para calcular números de Bernoulli a través de tarjetas perforadas. Hoy en día, ese plan está considerado como el primer programa de ordenador escrito cien años antes de que se fabricase el primero. Por ello, Ada Lovelace es considerada la primera programadora de la historia. De hecho, inventó una forma para describir algoritmos en la máquina analítica, creando el primer lenguaje de programación.

Los Avances del Siglo XX: Hollerith y el Nacimiento de las Computadoras Electrónicas

En 1890, Herman Hollerith revolucionó la forma en que se manejaba la información con su máquina de tarjetas perforadas, utilizada para el censo de Estados Unidos. Este invento marcó el comienzo del procesamiento automatizado de datos y fue el primer ordenador que usaba electricidad.

Como funcionan las tarjetas perforadas:

El siglo XX vio avances aún más significativos con las primeras computadoras electromecánicas como la Z3 de Konrad Zuse y la Harvard Mark I, que pusieron las bases para la era electrónica.

Alan Turing: El Padre de la Computación Moderna

En 1937, Alan Turing introdujo el concepto de la máquina de Turing, un modelo matemático que sentó las bases de la computación teórica. Turing demostró que las computadoras podían realizar cualquier cálculo lógico, siempre que se les diera el algoritmo correcto.

Durante la Segunda Guerra Mundial, Turing también jugó un papel crucial en la criptografía al ayudar a descifrar los códigos de la máquina Enigma, lo que contribuyó significativamente a la victoria aliada.

Alan Turing, introdujo la “máquina de Turing”, un modelo teórico que define lo que puede ser computado. Su concepto influyó en el desarrollo de las primeras computadoras y en el campo de la inteligencia artificial. La máquina de Turing es fundamental para entender la teoría de la computación y los límites de lo que las máquinas pueden calcular.

Como funcionan las Maquina Enigma:

Alan Turing, introdujo la “máquina de Turing”, un modelo teórico que define lo que puede ser computado. Su concepto influyó en el desarrollo de las primeras computadoras y en el campo de la inteligencia artificial. La máquina de Turing es fundamental para entender la teoría de la computación y los límites de lo que las máquinas pueden calcular.

Durante la Segunda Guerra Mundial, la computación jugó un papel crucial en la criptografía.

Colossus fue la primera computadora electrónica digital programable, diseñada específicamente para ayudar a descifrar los mensajes alemanes encriptados con la máquina Lorenz, utilizada para comunicaciones de alto mando nazi.

Colossus fue desarrollado por Tommy Flowers y su equipo, y comenzó a operar en 1944.

⚙️ Dato Curioso:

Mientras Turing fue más relevante en la lucha contra Enigma, Colossus fue una herramienta esencial para descifrar Lorenz, otro tipo de cifrado alemán utilizado en las comunicaciones de alto mando nazi durante la Segunda Guerra Mundial.

El Auge de las Computadoras Electrónicas: ENIAC, UNIVAC y Más Allá

Después de Turing, el modelo de la máquina de Turing inspiró desarrollos como las máquinas probabilísticas y los primeros ordenadores electrónicos. La Z3 de Konrad Zuse, creada en 1941, es considerada la primera computadora programable, mientras que la Harvard Mark I, construida en 1943, fue una de las primeras computadoras electromecánicas.

Con el fin de la guerra, las computadoras electrónicas como ENIAC y UNIVAC llevaron la tecnología a un nuevo nivel. Estas máquinas utilizaron válvulas de vacío, lo que permitió un procesamiento de datos mucho más rápido. Aunque ocupaban habitaciones enteras, fueron precursoras de los dispositivos que hoy caben en la palma de la mano.

Píldora · Generaciones Computacionales ->Del Vacío al SilicioDel cableado manual y las válvulas de vacío al primer ordenador comercial.

|

|

🚀 Dato Técnico:

ENIAC podía realizar 5,000 sumas por segundo, algo impresionante para la época, pero hoy en día cualquier smartphone es millones de veces más rápido.

⚙️Realiza la tarea propuesta:

Este video ofrece una revisión completa de la evolución de las computadoras desde los años 1930 hasta la actualidad.

¡Es un viaje fascinante a través del tiempo y la tecnología!

Te invitamos a observar el video y, utilizando tu editor de presentaciones favorito, crear una línea de tiempo que resuma los hitos más importantes de la historia de la computación.

Transistores, Circuitos Integrados y la Computación Personal

La invención del transistor en 1947 reemplazó a las válvulas de vacío, dando lugar a la segunda generación de computadoras. A partir de este punto, los avances se dispararon: en los años 60, el circuito integrado permitió una miniaturización sin precedentes, llevando al desarrollo de las primeras computadoras personales (PCs).

En los años 80, con el auge de PCs como el IBM PC y sistemas operativos como MS-DOS y Windows, la computación dejó de ser cosa de expertos y se convirtió en una herramienta de uso común en hogares y oficinas.

El Siglo XXI: Computación en la Nube, Big Data e Inteligencia Artificial

La llegada del siglo XXI marcó el inicio de la era digital. La computación en la nube permite almacenar y acceder a información desde cualquier lugar del mundo, mientras que el big data ayuda a analizar grandes volúmenes de datos para la toma de decisiones.

Por su parte, la inteligencia artificial (IA) está redefiniendo industrias enteras, desde la medicina hasta la automoción. Con el desarrollo de redes neuronales y aprendizaje automático, las máquinas están aprendiendo a tomar decisiones y realizar tareas de forma autónoma.

Reflexión Final: La historia de la computación no es solo un viaje tecnológico, sino también una fuente de inspiración para el futuro, mostrando cómo la innovación constante puede transformar nuestra manera de vivir y trabajar.